IA Transparente: Como Entender e Confiar em Sistemas de IA

Como a Inteligência Artificial Explicável Aumenta Transparência, Confiança e Conformidade Regulatória nos Sistemas de IA

Inteligência Artificial Explicável permite entender e confiar nas decisões da IA, oferecendo transparência, ética e conformidade regulatória para sistemas automatizados.

Você já ouviu falar em Inteligência Artificial Explicável? Ela é o que traz transparência para os sistemas de IA, ajudando a gente a entender e confiar nas decisões automáticas que afetam nosso dia a dia. Quer saber como isso funciona? Então continua aqui comigo.

O que é a inteligência artificial explicável?

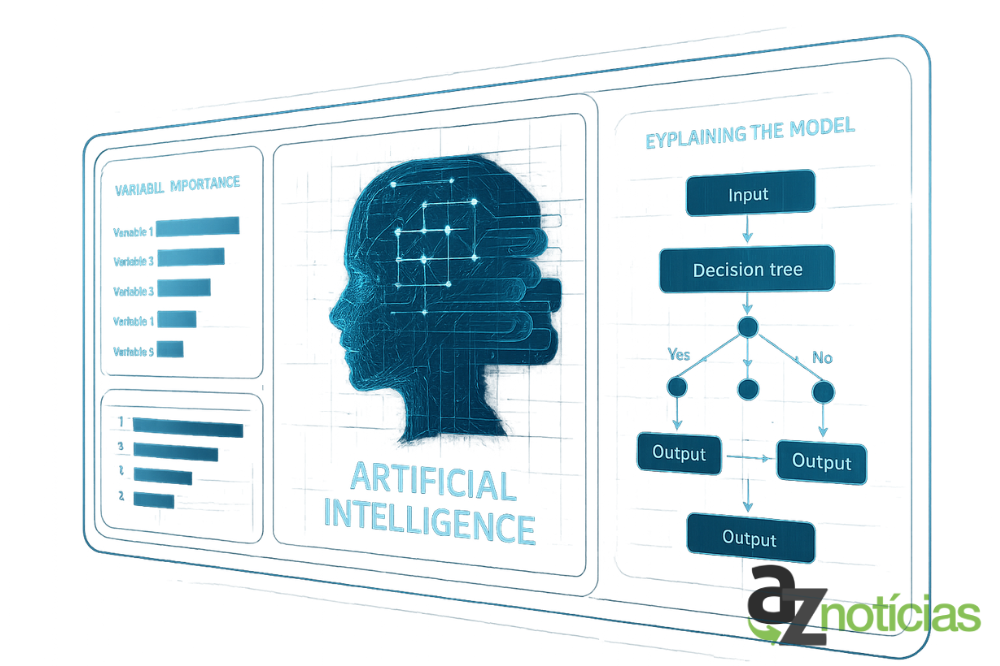

Inteligência Artificial Explicável (IAE) é uma área da inteligência artificial que busca tornar os processos e decisões dos sistemas de IA compreensíveis para humanos. Diferentemente dos modelos tradicionais, muitas vezes vistos como “caixas-pretas”, a IAE fornece clareza sobre como e por que uma decisão foi tomada.

Essa explicação é fundamental para garantir transparência, aumentar a confiança dos usuários e permitir a avaliação crítica dos sistemas. Por exemplo, em uma análise de crédito automatizada, a IAE permite ao cliente e ao banco entender quais fatores influenciaram a aprovação ou rejeição.

A IAE utiliza técnicas que mostram os elementos mais relevantes para a decisão do modelo, como gráficos de importância, regras claras e visualizações intuitivas. Assim, especialistas e usuários comuns podem analisar o funcionamento de sistemas complexos.

Principais características da IA explicável

- Fornece justificativas para cada decisão feita.

- Facilita a identificação de erros e vieses nos modelos.

- Aumenta a responsabilidade e a ética no uso da IA.

- Melhora a interação entre humanos e máquinas.

Com a expansão do uso de inteligência artificial em áreas sensíveis, como saúde e finanças, entender como funciona cada decisão é uma necessidade crescente. A IA explicável aparece como resposta para esses desafios, ajudando a construir sistemas mais seguros e confiáveis.

Por que a transparência importa na IA?

A transparência na inteligência artificial é essencial para garantir que as decisões automáticas sejam compreendidas e confiáveis. Quando um sistema de IA apresenta resultados obscuros ou inexplicáveis, aumenta o risco de erros, preconceitos e desconfiança dos usuários.

Sem transparência, torna-se difícil detectar falhas ou vieses que podem gerar injustiças, especialmente em áreas sensíveis como saúde, justiça e finanças. Por isso, oferecer explicações claras sobre o funcionamento dos modelos é fundamental para a ética e responsabilidade no uso da IA.

Benefícios da transparência na IA

- Confiança do usuário: Ajuda as pessoas a entenderem e aceitarem as decisões automáticas.

- Identificação de erros: Facilita a correção e melhoria dos sistemas.

- Conformidade legal: Atende às exigências regulatórias que clamam por explicações claras.

- Inovação segura: Incentiva o desenvolvimento de soluções responsáveis e humanas.

Além disso, a transparência impulsiona a colaboração entre desenvolvedores, especialistas e usuários, promovendo um ambiente tecnológico mais aberto e inclusivo. Portanto, a clareza nos processos de IA não é apenas técnica, mas também social e ética.

Principais técnicas para explicar modelos de IA

Existem várias técnicas que ajudam a tornar os modelos de inteligência artificial mais compreensíveis. Essas técnicas buscam explicar como a IA chega às suas decisões, facilitando a interpretação por humanos.

Técnicas baseadas em explicações locais

Essas técnicas mostram quais partes dos dados influenciaram uma decisão específica. Um exemplo conhecido é o LIME (Local Interpretable Model-Agnostic Explanations), que cria modelos simples próximos à decisão para explicar seu funcionamento.

Técnicas baseadas em importância de características

Elas identificam quais variáveis tiveram maior peso no resultado final do modelo. Métodos como SHAP (SHapley Additive exPlanations) distribuem a importância de forma justa entre as características, facilitando a visualização dos fatores mais relevantes.

Modelos interpretáveis por design

Alguns modelos são criados para serem transparentes desde o início, como árvores de decisão simples, regressões lineares e regras baseadas em lógica. Esses modelos permitem uma compreensão direta do processo.

Visualizações e gráficos

Gráficos de dependência parcial, mapas de calor e outras visualizações ajudam a interpretar modelos complexos, mostrando como as variáveis influenciam a predição de forma visual e intuitiva.

Essas técnicas são fundamentais para a transparência e para evitar decisões inesperadas ou injustas em sistemas de IA, além de facilitar a comunicação entre especialistas técnicos e usuários finais.

Impactos da IA explicável no dia a dia das empresas

A aplicação da Inteligência Artificial Explicável nas empresas transforma a forma como decisões são tomadas, tornando processos mais claros e confiáveis. Isso melhora a comunicação entre áreas técnicas e de negócios, reduzindo erros causados por decisões automáticas sem transparência.

Melhoria na tomada de decisão

Com explicações claras, gestores entendem os porquês por trás dos resultados gerados pela IA e podem ajustar estratégias com mais segurança e agilidade. Isso evita riscos e promove decisões baseadas em dados confiáveis.

Aumento da confiança dos clientes e parceiros

Sistemas que oferecem transparência aumentam a confiança externa, especialmente em setores como financeiro e saúde, onde a explicação das decisões é imprescindível para o relacionamento com o cliente e cumprimento de normas.

Redução de riscos legais e conformidade

Ao tornar as decisões auditáveis e compreensíveis, a IA explicável ajuda as empresas a atenderem legislações e políticas internas, minimizando riscos jurídicos e problemas com órgãos reguladores.

Otimização dos processos internos

Funcionários conseguem identificar mais facilmente falhas e potenciais melhorias nos sistemas, garantindo a eficiência operacional e facilitando treinamentos e atualizações.

Assim, a IA explicável não é apenas uma ferramenta técnica, mas uma alavanca importante para a inovação responsável e sustentável nos negócios, alinhada às expectativas modernas de transparência e segurança.

Diferenças entre IA tradicional e IA explicável

A inteligência artificial tradicional geralmente funciona como uma “caixa preta”: ela processa dados e gera resultados sem oferecer muita transparência sobre como as decisões são feitas. Isso pode dificultar a compreensão e a confiança nos sistemas, especialmente quando as decisões têm impactos importantes.

Já a IA explicável foca em abrir essa caixa preta, oferecendo maneiras claras e acessíveis de entender os processos internos do modelo. Isso inclui apresentar quais fatores influenciaram as previsões e fornecer justificativas compreensíveis para humanos.

Principais diferenças

- Transparência: A IA tradicional é opaca, enquanto a explicável prioriza a clareza.

- Interpretabilidade: A explicável permite entender o raciocínio, o modelo tradicional não.

- Responsabilidade: A IA explicável facilita identificar erros e corrigir vieses.

- Aplicações: A IA explicável é preferida em áreas que exigem confiança, como saúde, finanças e segurança.

Essas diferenças indicam que a IA explicável é fundamental para garantir a ética e a segurança no uso crescente da inteligência artificial, tornando suas aplicações mais confiáveis e aceitáveis socialmente.

Como a explicabilidade contribui para a ética em IA

A explicabilidade é um elemento crucial para garantir a ética na inteligência artificial. Quando os sistemas de IA são capazes de justificar suas decisões, fica mais fácil identificar possíveis erros, vieses ou injustiças que possam prejudicar indivíduos ou grupos.

Transparência para decisões justas

Sistemas explicáveis permitem que especialistas avaliem se uma decisão foi tomada com base em critérios adequados, evitando discriminações involuntárias e promovendo a igualdade no tratamento.

Responsabilização e conformidade

Com explicações claras, fica mais fácil responsabilizar desenvolvedores e empresas pelo uso dos algoritmos. Isso também assegura o cumprimento de legislações que exigem que decisões automatizadas possam ser auditadas.

Engajamento e confiança dos usuários

Quando as pessoas entendem como a IA funciona e por que determinadas decisões são tomadas, aumentam a confiança nas tecnologias e aceitação social do seu uso, o que é fundamental para a adoção ética.

Além disso, a explicabilidade impede o uso irresponsável da IA, orientando práticas mais transparentes e conscientes, alinhadas aos valores humanos e sociais.

Desafios técnicos e limitações atuais

Embora a inteligência artificial explicável traga muitos benefícios, ainda enfrenta desafios técnicos importantes que limitam sua aplicação em larga escala.

Complexidade dos modelos

Modelos avançados de IA, como redes neurais profundas, são naturalmente difíceis de interpretar. A explicação completa pode ser complexa demais para humanos entenderem facilmente.

Trade-off entre precisão e interpretabilidade

Muitas vezes, modelos mais explicáveis têm desempenho inferior em comparação com modelos complexos e menos transparentes, o que gera um dilema entre obter resultados precisos e explicações claras.

Falta de padrões e métricas consolidadas

Não há um padrão universal que defina o que torna uma explicação satisfatória, dificultando a avaliação da qualidade das explicações geradas.

Escalabilidade para grandes volumes de dados

Gerar explicações para sistemas que processam grandes quantidades de dados em tempo real ainda é um desafio, devido à demanda computacional e necessidade de respostas rápidas.

Diversidade de usuários e níveis de entendimento

Explicar modelos para diferentes públicos, que variam em conhecimento técnico, exige abordagens personalizadas, o que nem sempre é fácil de implementar.

Esses desafios mostram que a IA explicável ainda está em desenvolvimento, mas avanços constantes buscam superar essas limitações para tornar os sistemas mais acessíveis e confiáveis.

Ferramentas e frameworks mais usadas para IA explicável

Existem diversas ferramentas e frameworks que facilitam a implementação da IA explicável, ajudando desenvolvedores a criar modelos mais transparentes e compreensíveis.

LIME (Local Interpretable Model-Agnostic Explanations)

É uma ferramenta popular que explica as previsões de qualquer modelo de IA destacando as características mais relevantes para cada decisão específica, mesmo em modelos complexos.

SHAP (SHapley Additive exPlanations)

Framework que utiliza conceitos da teoria dos jogos para calcular a contribuição de cada variável para o resultado final, oferecendo explicações consistentes e precisas para os modelos.

Explainable Boosting Machine (EBM)

Parte da biblioteca Microsoft InterpretML, o EBM cria modelos flexíveis e com alta interpretabilidade, com visualizações claras para análise direta dos efeitos das variáveis.

AI Fairness 360 (IBM)

Ferramenta focada em detectar e mitigar vieses em modelos de IA, promovendo explicações para garantir decisões mais justas e responsáveis.

Captum (Facebook)

Framework para explicação de modelos baseados em aprendizado profundo, oferecendo várias técnicas para entender o impacto das entradas nas previsões.

Essas ferramentas são essenciais para empresas que buscam aliar eficiência com transparência, garantindo que os sistemas de IA possam ser compreendidos, auditados e confiáveis.

Exemplos práticos de aplicação em setores variados

A inteligência artificial explicável já é aplicada em diversos setores, ajudando empresas a tomar decisões mais transparentes e confiáveis.

Saúde

Na medicina, a IA explicável auxilia no diagnóstico de doenças ao fornecer justificativas claras sobre os resultados das análises, ajudando médicos a entenderem a base das recomendações.

Financeiro

Bancos e instituições financeiras usam a IA explicável para aprovar ou negar crédito, mostrando quais fatores influenciaram a decisão, o que aumenta a confiança e reduz fraudes.

Varejo

No varejo, sistemas explicáveis otimizam o gerenciamento de estoque e personalizam ofertas, mostrando aos gerentes os motivos por trás das sugestões feitas pela IA.

Setor jurídico

Ferramentas de IA explicável ajudam na análise de documentos e precedentes, com transparência sobre critérios usados para auxiliar advogados em suas decisões.

Esses exemplos demonstram como a IA explicável torna a inteligência artificial uma ferramenta mais acessível, segura e ética, com impacto positivo em variadas áreas.

O papel da IA explicável na regulamentação e legislação

A IA explicável desempenha um papel fundamental na regulamentação e legislação dos sistemas de inteligência artificial. Governos e órgãos reguladores exigem que as decisões automatizadas sejam transparentes para garantir direitos dos cidadãos.

Conformidade com leis

Leis como a regulamentação geral de proteção de dados (LGPD no Brasil e GDPR na Europa) exigem que as decisões tomadas por IA possam ser explicadas para evitar abuso e garantir privacidade.

Auditoria e fiscalização

Ferramentas de IA explicável facilitam a auditoria dos sistemas, permitindo que órgãos reguladores compreendam o funcionamento das decisões automatizadas e verifiquem se estão em conformidade com padrões éticos e legais.

Responsabilidade e transparência

A explicabilidade ajuda a atribuir responsabilidade em casos de erros ou decisões injustas, tornando mais fácil identificar falhas e promover correções rápidas.

Incentivo à adoção ética

Regulamentações que valorizam a IA explicável incentivam empresas a adotarem práticas responsáveis, priorizando a transparência e a segurança na implementação da IA.

Assim, a IA explicável contribui para um ambiente tecnológico mais seguro, justo e confiável, alinhando inovação com proteção dos direitos dos consumidores e da sociedade.

Como começar a implementar IA explicável no seu negócio

Para implementar a IA explicável no seu negócio, é fundamental seguir etapas claras para garantir que os sistemas sejam transparentes e confiáveis desde o início.

Identifique os casos de uso

Comece escolhendo áreas onde a explicabilidade é mais necessária, como decisões que impactam clientes ou processos regulados, garantindo foco e eficiência na implementação.

Escolha ferramentas adequadas

Utilize frameworks e ferramentas populares, como LIME e SHAP, que facilitam a geração de explicações claras para modelos complexos.

Desenvolva modelos interpretáveis

Prefira modelos que já sejam explicáveis, como árvores de decisão ou regressão, e complemente modelos mais complexos com técnicas de explicação local.

Treine a equipe

Capacite os colaboradores para entenderem as saídas da IA explicável, facilitando a análise crítica dos resultados e a identificação de possíveis melhorias.

Implemente processos de auditoria

Estabeleça rotinas para revisar as decisões da IA e garantir que estejam alinhadas com as políticas internas e regulamentações externas.

Monitore e ajuste

A IA explicável requer manutenção contínua para adaptar-se às mudanças nos dados e no negócio, assegurando que as explicações permaneçam relevantes e confiáveis.

Seguindo esses passos, sua empresa estará preparada para aproveitar os benefícios da IA explicável com responsabilidade e eficiência.

Considerações finais sobre IA explicável

A inteligência artificial explicável é fundamental para garantir transparência, confiança e responsabilidade nos sistemas de IA usados pelas empresas.

Ao implementar essas tecnologias com clareza, as organizações conseguem tomar decisões mais justas, cumprir regulamentações e aumentar a segurança dos seus processos.

Investir em IA explicável é investir em inovação ética, que valoriza tanto resultados eficientes quanto o respeito aos direitos e à compreensão dos usuários.

Por isso, é importante começar com planejamento, escolher as ferramentas certas e capacitar a equipe para aproveitar todo o potencial dessa abordagem.